Rispondi

Rispondi a:

"Non conta tanto l'intelligenza artificiale in sè, quanto l'intelligenza artificiale in me"

La questione ha stimolato tanti articoli e saggi che, indipendentemente dalla moda e dalla pubblicità, criticano la natura dell’intelligenza artificiale, sotto l’aspetto storico, filosofico, antropologico e sociale, oltre che tecnico-scientifico.

Tra questi “La scorciatoia - Come le macchine sono diventate intelligenti senza pensare in modo umano” di Nello Cristianini, il Mulino Editore, che indica quali scorciatoie intellettuali hanno permesso di raggiungere cotanti risultati:

- Abbiamo prima cercato di riprodurre nelle macchine il ragionamento logico, simbolico e formale, come quello matematico, ed a farle ragionare con la grammatica per il linguaggio, con risultati interessanti ma effimeri, come i Sistemi Esperti.

Invece è bastato accontentarsi di statistiche che consentano previsioni adeguate, come quelle per raccomandare libri, senza comprendere né il loro contenuto né le personalità dei lettori. - Si potevano insegnare tali statistiche alle macchine con schiere di addetti, ma è stato meglio farle ricavare da dati esistenti, come la marea di quelli che depositiamo spontaneamente su Internet, nel Web, nelle Reti Sociali, ecc..

- E per sapere quello che vogliamo, invece di chiedercelo esplicitamente, le macchine imparano osservando sistematicamente le nostre scelte.

“Ciò che mi preme mostrare è che lo sviluppo dell’IA fino a oggi non è andato tanto nella direzione dell’emulazione o del superamento dell’intelligenza umana, quanto verso lo sviluppo di sistemi in grado di convincere noi umani che le macchine sono intelligenti”.

Estratto dal saggio “Macchine ingannevoli - comunicazione, tecnologia, intelligenza artificiale” di Simone Natale, Einaudi Editore, che mette in luce la nostra propensione, individuale e sociale, a scorgere dell’intelligenza negli oggetti con cui abbiamo a che fare, a partire dall’animismo nella Natura fino all’interlocuzione con agenti automatici intelligenti (ChatterBOT), dallo storico Eliza all’ultimo ChatGPT.

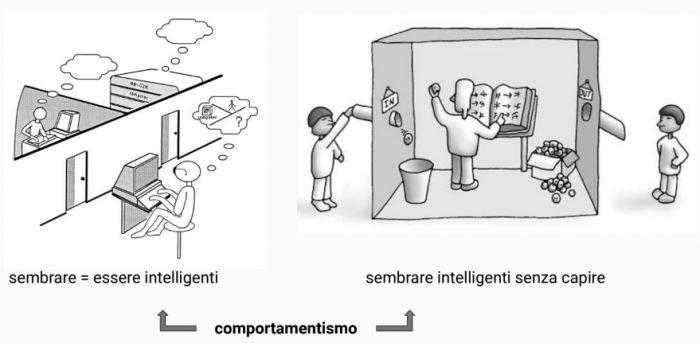

Da tempo sono stati proposti criteri per valutare l’intelligenza delle macchine dal loro comportamento, indipendentemente dal loro funzionamento (comportamentismo): il Test di Turing (originariamente “gioco”) presuppone che se il computer appare intelligente è intelligente e viceversa la Stanza Cinese di Searle vuole dimostrare che, se anche il computer apparisse intelligente, non capirebbe comunque nulla.

Oggi i progressi della traduzione automatica e dell’intelligenza artificiale generativa sembrano smentire Searle, generando loro stessi istruzioni adeguate alla traduzione, mentre soddisfano l'approccio euristico di Turing: una sorta di gioco dell’impostore, che sfrutta la nostra tendenza a proiettare intelligenza e umanità su macchine in grado di comunicare efficientemente, anche in assenza di un'autentica capacità di pensiero o empatia.

Accedi

Devi inserire Nome utente e Password per inviare un messaggio. Se non li hai prosegui inserendo il contenuto della risposta e i dati personali (nome, cognome e email) oppure Registrati